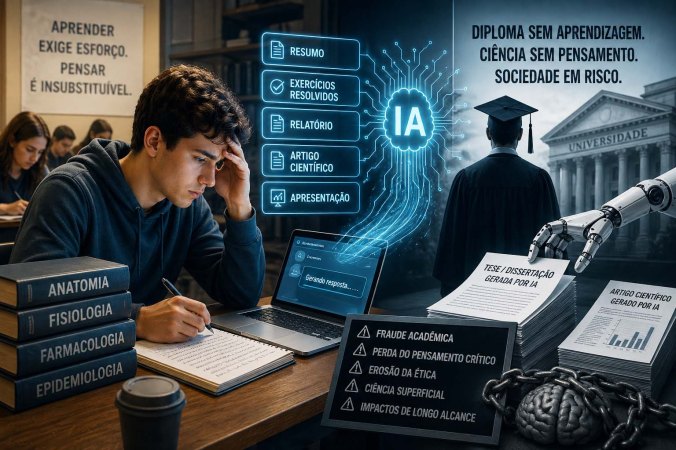

O uso descontrolado de IA ameaça a formação crítica de estudantes e o futuro da produção científica

Nos últimos dois anos, a inteligência artificial (IA) deixou de ser uma curiosidade tecnológica para se tornar presença constante no cotidiano universitário. Hoje, uma quantidade significativa de estudantes consegue gerar resumos, resolver exercícios, escrever relatórios, montar apresentações e até produzir artigos científicos completos em questão de minutos. À primeira vista, isso parece apenas mais uma revolução tecnológica inevitável. Mas basta olhar com um pouco mais de atenção para perceber que estamos diante de um problema muito mais profundo, e potencialmente devastador para a formação universitária, a ética acadêmica e o próprio futuro da ciência. O ponto central é simples: o uso descontrolado da IA está corroendo silenciosamente o próprio processo de formação universitária.

A universidade nunca teve como missão apenas entregar diplomas. O papel histórico das universidades sempre foi formar profissionais capazes de pensar, analisar, argumentar, duvidar e tomar decisões em contextos complexos. Em outras palavras, formar autonomia intelectual. E isso não se constrói com respostas prontas, pois toda a experiência acumulada mostra que isso se constrói com esforço cognitivo, erro, tentativa, leitura difícil e escrita trabalhosa. É justamente esse processo que a IA começa a substituir, e rapidamente assimilada em nome da formação mais veloz de profissionais que estariam sendo ansiosamente esperados pelo mercado.

O problema é que disciplinas obrigatórias existem por uma razão. Elas definem o perfil profissional que a sociedade espera de um engenheiro, de um médico, de um advogado, de um cientista. Anatomia, fisiologia, farmacologia e epidemiologia não são obstáculos burocráticos na formação médica; são a base que sustenta decisões clínicas que podem salvar ou perder vidas. Quando um estudante terceiriza a resolução de exercícios, a escrita de relatórios ou a síntese de textos para uma IA, ele pode até entregar um trabalho perfeito, mas sem ter trilhado o caminho cognitivo necessário para, de fato, aprender. O fato é que estamos criando, silenciosamente, a figura do profissional diplomado sem domínio real das competências fundamentais.

E aqui o risco deixa de ser educacional e passa a ser social. Imaginemos médicos excessivamente dependentes de sistemas automatizados para interpretar exames ou propor diagnósticos. Imagine engenheiros incapazes de avaliar criticamente um cálculo gerado por software. Imaginemos cientistas que nunca desenvolveram plenamente a capacidade de formular perguntas originais. Esse cenário não é ficção científica, pois ele está começando a ser construído agora, dentro das universidades em todo o mundo.

Um dos efeitos mais preocupantes desse processo é a terceirização do esforço cognitivo. Pensar exige treino constante. Leitura profunda exige prática. Escrever exige sofrimento intelectual. Quando a IA passa a realizar essas tarefas com rapidez e fluidez, muitos estudantes deixam simplesmente de exercitar essas habilidades. Aos poucos, a tolerância à complexidade diminui, a capacidade de concentração se reduz e a autonomia intelectual se fragiliza. A tecnologia criada para ampliar capacidades humanas começa, paradoxalmente, a atrofiá-las.

O impacto ético também é gigantesco. A fraude acadêmica entrou em uma nova fase. Durante décadas, plagiar significava copiar textos existentes. Hoje, tornou-se possível produzir trabalhos inteiros sem dominar o conteúdo e com baixíssima probabilidade de detecção. As universidades estão enfrentando uma crise silenciosa: trabalhos deixaram de ser evidência confiável de aprendizagem. Se professores não conseguem distinguir autoria humana de produção automatizada, as notas deixam de refletir competência real e os diplomas passam a sinalizar muito menos do que deveriam. Isso ameaça a credibilidade institucional do ensino superior. Mas talvez o impacto mais grave esteja acontecendo na própria ciência. A escrita acadêmica sempre foi parte essencial da formação de pesquisadores. Dissertações e teses não são apenas produtos finais; são rituais de passagem intelectual, mas um momento em que o estudante aprende a formular problemas, estruturar argumentos, lidar com incertezas e construir pensamento original. Quando a IA entra como autora invisível, esse processo formativo se enfraquece.

Já começamos a ver sinais de uma possível “industrialização” da escrita científica: revisões de literatura produzidas em massa, artigos inflacionados, textos plausíveis mas superficiais. Existe o risco real de uma poluição textual da ciência — mais artigos publicados, mas menos pensamento crítico por trás deles. Em um cenário extremo, poderemos ter IA escrevendo artigos e IA ajudando a revisá-los, enquanto a participação humana se torna cada vez mais periférica. A ciência perderia sua função mais importante: o escrutínio crítico humano. Mas tudo indica que este cenário extremo já está entre nós, representando uma grave ameaça para o futuro da ciência enquanto um empreendimento que deveria servir para melhorar a vida da maioria da Humanidade.

Diante desse quadro, a resposta não pode ser fingir que nada está acontecendo. Tampouco é realista imaginar a proibição total da IA. O que precisamos urgentemente é de regulação pedagógica séria. Primeiro, é inevitável reformular os sistemas de avaliação. Provas presenciais, avaliações orais, defesas públicas e atividades realizadas em tempo real precisam voltar ao centro do processo educativo. Não como nostalgia do passado, mas como estratégia para garantir que o estudante realmente pense no que e sobre o que está fazendo. Na medicina, isso significa reforçar simulações clínicas presenciais e avaliações de raciocínio diagnóstico ao vivo. Segundo, o uso de IA precisa ser declarado de forma obrigatória em qualquer produção acadêmica. Transparência deve se tornar regra básica. Terceiro, universidades precisam ensinar IA de forma crítica. Não basta permitir o seu uso, pois é preciso formar usuários capazes de compreender limites, vieses e riscos epistemológicos dessas ferramentas. E, acima de tudo, precisamos reafirmar um princípio simples: aprender não é produzir textos; aprender é desenvolver pensamento crítico e autônomo.

A IA não é apenas mais uma ferramenta já que ela redefine o que significa estudar, pesquisar e produzir conhecimento. Se continuarmos ignorando os riscos do uso descontrolado da IA, poderemos formar uma geração altamente certificada, mas intelectualmente frágil , e uma ciência que se tornará cada vez mais volumosa, porém menos crítica e, consequentemente, avessa às reais necessidades que a atual conjuntura histórica de um planeta em colapso climático impõe.

Finalmente, há que se reconhecer que a IA não é apenas mais uma ferramenta tecnológica incorporada ao cotidiano universitário dado que ela redefine silenciosamente o próprio significado de estudar, pesquisar, ensinar e produzir conhecimento. Se continuarmos tratando seu uso irrestrito como um fenômeno neutro ou inevitável, corremos o risco de formar uma geração altamente certificada, porém intelectualmente frágil; uma ciência cada vez mais volumosa, mas progressivamente menos crítica; e universidades que preservam rituais formais de avaliação enquanto perdem sua função substantiva de formação. O que está em jogo não é apenas a integridade acadêmica ou a qualidade dos diplomas, mas a própria capacidade da sociedade humana de produzir profissionais capazes de lidar com problemas complexos, tomar decisões responsáveis e sustentar práticas científicas confiáveis. Em última instância, se trata de preservar a credibilidade social da universidade e o papel civilizatório da ciência. Desta forma, o verdadeiro desafio não é impedir a IA, algo impossível a estas alturas do campeonato, mas impedir que ela substitua aquilo que constitui a essência da educação superior: o desenvolvimento paciente, exigente e insubstituível de mentes autônomas, críticas, criativas e responsáveis. Sem essa reação por parte das universidades e da comunidade científica, o risco é que a automação intelectual avance mais rápido do que nossa capacidade coletiva de compreender suas consequências, deixando para o futuro o custo de uma formação que parece moderna, eficiente e produtiva, mas que poderá se revelar profundamente vazia e antissocial.